如何评价 Microsoft HoloLens 这款产品?

来源:网络整理 网络用户发布,如有版权联系网管删除 2018-08-01

引用宣传视频里面的一句话:

It was science fiction,M$ brings it into science fact.

===========

一月23日零点更新了关于发布时间,硬件实现,HoloLens与全息对比的一些内容。

看完以后第一时间真的很震撼。冷静下来以后仔细推敲了一下技术。看法是,时势造英雄的震撼产品。就像之前对google glass的幻想一样。我之前玩过Oculus,写过LeapMotion的API,折腾过Kinect的Point Cloud,对这俩“虚拟现实”产品都感到大失所望,而HoloLens正是我想要的。

hololens所实现的效果并不是微软一家的创新,他早已流传在种种科幻电影中。

但能做到hololens所需要的程度是一个极其复杂的工程。

HoloLens是一个Oculus+Kinect+Jetson TK1所集成起来的夹在鼻梁上的嵌入式怪物。

脑补一下把Kinect带到头上的情景

但是微软做到了!

首先给没有看宣传视频的孩子介绍下HoloLens吧,HoloLens是一个基于深度摄像头,高性能处理器和双屏幕显示的进阶版Glass

长这个样子

具体参见微软官网Microsoft HoloLens

根据我目前看到的信息,hololens需要技术支持的包括三个部分。

- 实时的三维计算

- 精准的姿态确定和位置确定。

这里解释一下什么是SLAM,就是通过传感器获取环境的有限信息,比如视觉信息,深度信息(Kinect),还有自身的加速度,角速度等来确定自己的相对或者绝对位置,并且完成对于地图的构建。

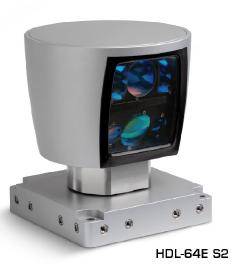

一个典型是电影《普罗米修斯》的中的探测器,使用一个激光雷达(以及内置姿态传感器)进行构建的小型探测器。

和生成的三维地图

和生成的三维地图 就是这张图把我引入了小型无人机的大坑。电影中,使用小型探测器扫描出来了隧道全景并且全息呈现了出来。

就是这张图把我引入了小型无人机的大坑。电影中,使用小型探测器扫描出来了隧道全景并且全息呈现了出来。对应到现实《普罗米修斯》里面用的是这种玩意

人民币价值相当于一辆低配的奥迪A8。可以发射几十束激光同时扫描。而Google无人车上面也用到了这种激光雷达来进行实时的路况分析。

人民币价值相当于一辆低配的奥迪A8。可以发射几十束激光同时扫描。而Google无人车上面也用到了这种激光雷达来进行实时的路况分析。对比微软做到的

这可是实现了三年前科幻电影的效果啊!

这可是实现了三年前科幻电影的效果啊!注意这张图,M$暗示进入一个房间之前要先进行扫描,这里明显是在用Deep Camera生成Point Cloud然后三角面片进行SLAM(我实验室的某个师兄在微软实习的时候,做的毕业设计也是这个玩意,微软对这个技术积累很强的)。如果确定是和Kinect类似的红外摄像头,那么可以认为kinect有的毛病他都会有。比如对于黑色物体,光滑表面的探测啊。

微软在Kinect使用的是红外线来进行深度探测。

可以说,HoloLens的核心难度是深度探测和相关的手势识别,对于微软来说这是其专长了,所以HoloLens是一个带到了鼻梁上的Kinect。

为什么说SLAM对于HoloLens非常重要呢?因为只有实现了靠谱的SLAM,才能知道眼镜的空间坐标和相对于室内各种障碍物的位置,同时识别出各种室内摆件的形状,这是宣传片中人机交互的基础。

毕竟业界的主流方案就那么几种,微软大概不可能像 @杨硕 兄造DJI Inspire 1那样用光流传感器。

这种图在出现的时候主人公一直在走动

而画面的稳定性很好

而画面的稳定性很好注意这里

可以看到对于各个表面的贴合度已经达到了SLAM的程度

可以看到对于各个表面的贴合度已经达到了SLAM的程度- 图像识别技术

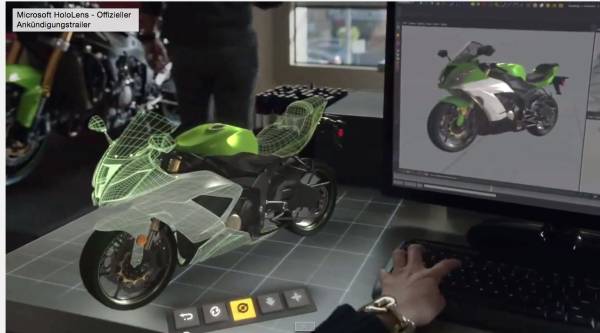

这里注意到一个细节,展示在三维空间中的UI很像是Autodesk Fusion的UI,难道自动桌已经先行一步?

这里注意到一个细节,展示在三维空间中的UI很像是Autodesk Fusion的UI,难道自动桌已经先行一步? 来自官网的一张图片,可以看到使用的正是Autodesk

来自官网的一张图片,可以看到使用的正是Autodesk作为半个工程师,我当时买Leap Motion就是为了玩Solidworks Fusion,现在有了HoloLens这种玩意,比Fusion体验不知道酸爽多少倍。脑部一下去参观EAST的时候眼睛里显示出EAST剖面的情景。太震撼。

这三个技术在近些年的成熟造就了hololens的产品化。之前我对购买google glass的设想与此类似。Hololens把它推向了现实。

其实hololens所实现的效果并不是新鲜货,早在冷战末期,武装直升机飞行员就通过头盔里面的信息来操作机枪所瞄准的方向。这两年我军也有装备。

当年su35的“回马枪”向后发射的导弹就是用尾椎雷达和头盔瞄准具实现的。

当年su35的“回马枪”向后发射的导弹就是用尾椎雷达和头盔瞄准具实现的。更进一步是这货用的这种

现在M$让大家都用得到。

现在M$让大家都用得到。另外,根据对hololens的技术分析,hololens可能会有如下一系列困难

第一,是耗电量。计算视觉和slam,再反过来进行三维虚拟现实是一个非常耗费计算量的任务。之所以说微软是时势造英雄,因为这种计算量在二十年前可是阿拉莫斯实验室用于核聚变模拟的计算量。现在只要耗电量跟的上,NVIDIA的Tegra K1还有Intel家的协处理器在嵌入式上飙计算量没问题。

我本来以为微软可能会引入一部分专用硬件加速,根据本问题里的某个微软员工的回答,他们引入了ASIC(专用集成电路)进行计算视觉。这也正常,Intel都发布了deep learning专用的芯片了。

第二,是在开放环境,欠光线环境的识别度问题。对此我持保守态度。需要拿到产品再说。

第三,是定位精准度问题。这是老大难问题了。

另一方面,这种配合将成为很长一段时间内的主流。

如果修的不是自来水管,而是血管,看到的是通过B超技术实时扫描出来的人体内部,那么未来的医院会是怎么样的。如果显示的不是自来水管的manual而是实时匹配无人机的爆炸视图,那么以后的工厂和DIY是怎么样的。让人难以想象的是,这一切居然是真的!

如果修的不是自来水管,而是血管,看到的是通过B超技术实时扫描出来的人体内部,那么未来的医院会是怎么样的。如果显示的不是自来水管的manual而是实时匹配无人机的爆炸视图,那么以后的工厂和DIY是怎么样的。让人难以想象的是,这一切居然是真的!微软研究院养了那么多闲人真的不是白养的。目前来看微软在这些技术上解决的都非常好。另外十分看好HoloLens+无人机的交互。拿到货以后我要做的第一件事情就是把我们的无人机系统移植上去。这画面太美。我简直不敢想。

还有多系统配合,这是像iPhone可以推动21世纪历史进程的玩意。

买买买!

===================

根据官网的时间线,Attend Build from April 29May 1, 2015. 五个月以后可以看到真货。

==========================

另外是质疑性能的人很多,但是就现场演示视频来说,HoloLens已经到了堪用的地步,对于一个跨时代的产品来说,这就够了。第一代产品必然是“好看而无用”的。但是前景在那里放着。

===================

另外是,估计Google也会有大动作,相关技术大部分有开源实现(包括廉价的深度摄像头),估计很快会有公司扛包出现类似设备的开源硬件和软件,市场一刺激华强北也不会安分,投资空间有多大各位手里有钱的掂量掂量吧。参见iPhone引发的历史轨迹。

另外是,全息估计不会成为主流发展方向了。

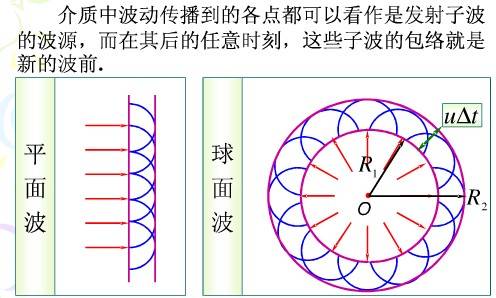

有人问为什么,这里我对比解释一下全息好了,所谓全息是指记录光信息的时候不仅仅纪录频率-振幅信息,还记录了相位信息。

这里要提一下惠更斯原理的概念

光是一种电磁波,也就是说,如果我想模拟一个物体看起来在那里的样子(全息),我可以在我和虚拟的物体之间放一个屏幕,计算出来波面上每一点的相位。按照物体应该有的样子原封不动的发送电磁波。

光是一种电磁波,也就是说,如果我想模拟一个物体看起来在那里的样子(全息),我可以在我和虚拟的物体之间放一个屏幕,计算出来波面上每一点的相位。按照物体应该有的样子原封不动的发送电磁波。全息的问题有二,第一是计算量巨大,相比于使用HoloLens的方式实现虚拟现实,全息需要计算空间中的波阵面(根据我某个小伙伴冬霜君的研究,一个勉强能看的全息效果计算量大约相当于一块GTX TITAN),第二是转化过程复杂,需要一种叫做声光转化器的东西来给定相位。起实现原理和另一个东西相似

这个东西叫做相控阵雷达,利用了惠更斯原理来实现雷达波迅速的方向切换,是国之重器。如图是法国阵风达索公司战斗机所装备的RBE-2雷达。

这个东西叫做相控阵雷达,利用了惠更斯原理来实现雷达波迅速的方向切换,是国之重器。如图是法国阵风达索公司战斗机所装备的RBE-2雷达。相控阵雷达的实现有很多,有使用可调参数的高频移相器的,有使用直接数字合成技术的。难道非常之高。是现代战斗机的一项关键技术。

学过中学物理的人应该都听过波粒二象性全息和现在的三维渲染相比,前者是考虑了光的波动性,后者仅仅考虑了光的粒子性。从计算上来说,前者复杂了一个维度。

相当于前者是波动方程的解

,后者仅仅是考虑振幅的衰减即可。

,后者仅仅是考虑振幅的衰减即可。换句话说,用HoloLens的方式,我们只需要计算物体相对于两个摄像头的三维效果,送给两个眼睛即可,不需要处理复杂的相位信息,无论是光栅或者ray track做渲染。计算量比全息小了一个维度,相当于电脑双开三维游戏。

所以说,全息更像是设备无法小型化年代对于未来的一种畅想。

还有,这个东西进入中国以后,广电会不会要求接入都要审批(显然会抢电视机的饭碗),我们拭目以待。

==================================

转载的时候请注明 “徐浩,科大物理在读,blog.xuhao1.me”。商业性转载请私信通知我。

==============================

利益相关,果粉,微软黑转粉

查看评论 回复